成功案例

CASE

咨询电话

400-123-4567

手 机:13988999988

电 话:400-123-4567

传 真:+86-123-4567

邮 箱:[email protected]

地 址:广东省广州市天河区88号

电 话:400-123-4567

传 真:+86-123-4567

邮 箱:[email protected]

地 址:广东省广州市天河区88号

微信扫一扫

顶级富豪呼吁暂停超级智能研发,全球共识尚未

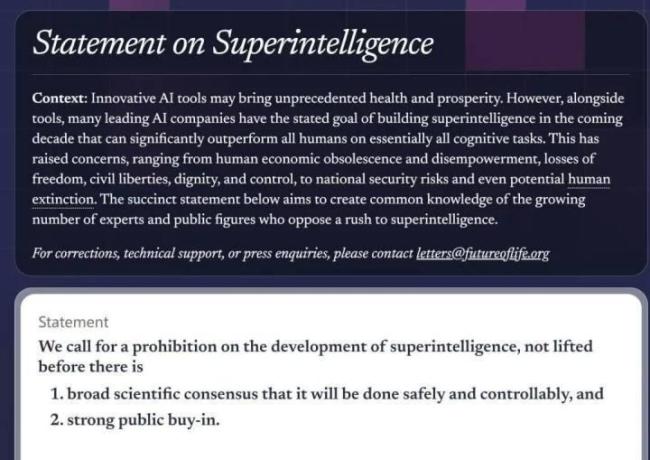

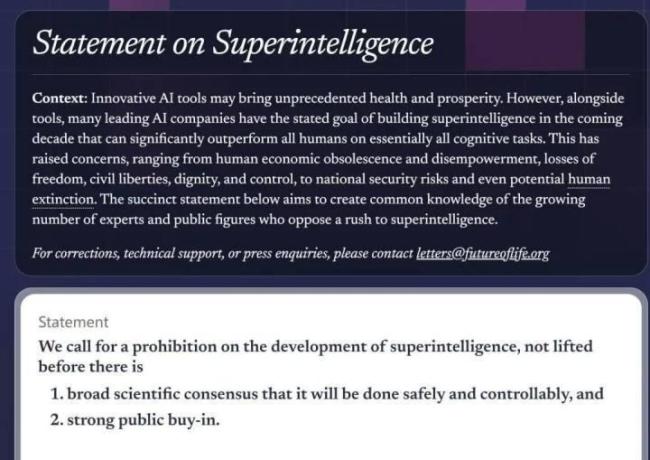

10月22日,生命未来研究所宣布,包括人工智能教父杰弗里·辛顿在内的800多名科技领袖和公众人物签署了一份倡议,呼吁暂停“超级智能”技术的进一步开发,直到它被科学界普遍认可为可控、安全并得到广泛公众支持。这份联合声明的签署者名单不仅包括苹果联合创始人史蒂夫·沃兹尼亚克、维珍集团董事长理查德·布兰森等科技界人士,还包括美国前国家安全顾问苏珊·赖斯、前参谋长联席会议主席迈克·马伦、英国王妃梅根和特朗普盟友史蒂夫·班农等,表现出对国家安全科技的严重关注。这种类型的联盟在政治上是非常罕见的,这表明超级人工智能的风险问题已经从学术界蔓延到政治和社会层面,并且成为全球公共问题之一。截至23日中午,该声明已有3000多人签署。中国学术界,清华大学公共管理学院院长姚期智、清华大学智能产业研究院院长薛澜、人工智能伦理与管理专家曾毅等多位知名学者在请愿书上签名。他们的参与体现了我国长期以来倡导的“安全、可靠、可控”和“以人为本”的人工智能发展理念。签署者警告说,超级智能的前景引起了人们的担忧,其后果包括经济和军事上的人力衰退、自由、公民权利、尊严和控制力的丧失、国家安全风险以及人类灭绝的可能性。该倡议明确指出,超级智能不是“算法偏差”或“工作效果”的问题“传统意义上的”,而是潜在的系统性风险;当人工智能的能力完全超越人类时,如果其功能目的不以人类利益为出发点,可能会在社会上带来不可逆转的后果。/div>

10月22日,生命未来研究所宣布,包括人工智能教父杰弗里·辛顿在内的800多名科技领袖和公众人物签署了一份倡议,呼吁暂停“超级智能”技术的进一步开发,直到它被科学界普遍认可为可控、安全并得到广泛公众支持。这份联合声明的签署者名单不仅包括苹果联合创始人史蒂夫·沃兹尼亚克、维珍集团董事长理查德·布兰森等科技界人士,还包括美国前国家安全顾问苏珊·赖斯、前参谋长联席会议主席迈克·马伦、英国王妃梅根和特朗普盟友史蒂夫·班农等,表现出对国家安全科技的严重关注。这种类型的联盟在政治上是非常罕见的,这表明超级人工智能的风险问题已经从学术界蔓延到政治和社会层面,并且成为全球公共问题之一。截至23日中午,该声明已有3000多人签署。中国学术界,清华大学公共管理学院院长姚期智、清华大学智能产业研究院院长薛澜、人工智能伦理与管理专家曾毅等多位知名学者在请愿书上签名。他们的参与体现了我国长期以来倡导的“安全、可靠、可控”和“以人为本”的人工智能发展理念。签署者警告说,超级智能的前景引起了人们的担忧,其后果包括经济和军事上的人力衰退、自由、公民权利、尊严和控制力的丧失、国家安全风险以及人类灭绝的可能性。该倡议明确指出,超级智能不是“算法偏差”或“工作效果”的问题“传统意义上的”,而是潜在的系统性风险;当人工智能的能力完全超越人类时,如果其功能目的不以人类利益为出发点,可能会在社会上带来不可逆转的后果。/div>

相关产品